Pernah nggak sih kamu baca syarat penggunaan sebuah aplikasi dan langsung garuk-garuk kepala bingung? Nah, itulah yang baru-baru ini terjadi dengan Microsoft Copilot. Para pengguna menemukan sesuatu yang cukup menggelitik — sekaligus bikin dahi berkerut — di dalam dokumen ketentuan layanan resmi Microsoft. Tulisannya kira-kira begini: Copilot hanya untuk “tujuan hiburan semata.” Tunggu dulu… Microsoft, kamu serius?

Ya, ini bukan hoaks. Dan kontan saja, kejadian ini langsung ramai diperbincangkan di internet. Bagaimana tidak, selama ini Microsoft dengan penuh semangat mempromosikan Copilot sebagai senjata andalan produktivitas — mulai dari Windows, Microsoft 365, hingga berbagai solusi perangkat lunak enterprise. Tapi di sisi lain, dokumen resmi mereka sendiri bilang jangan terlalu mengandalkan Copilot untuk hal-hal penting. Kontradiksi? Jelas banget!

Dari Bing Chat ke Copilot: Perjalanan yang Meninggalkan Jejak Lama

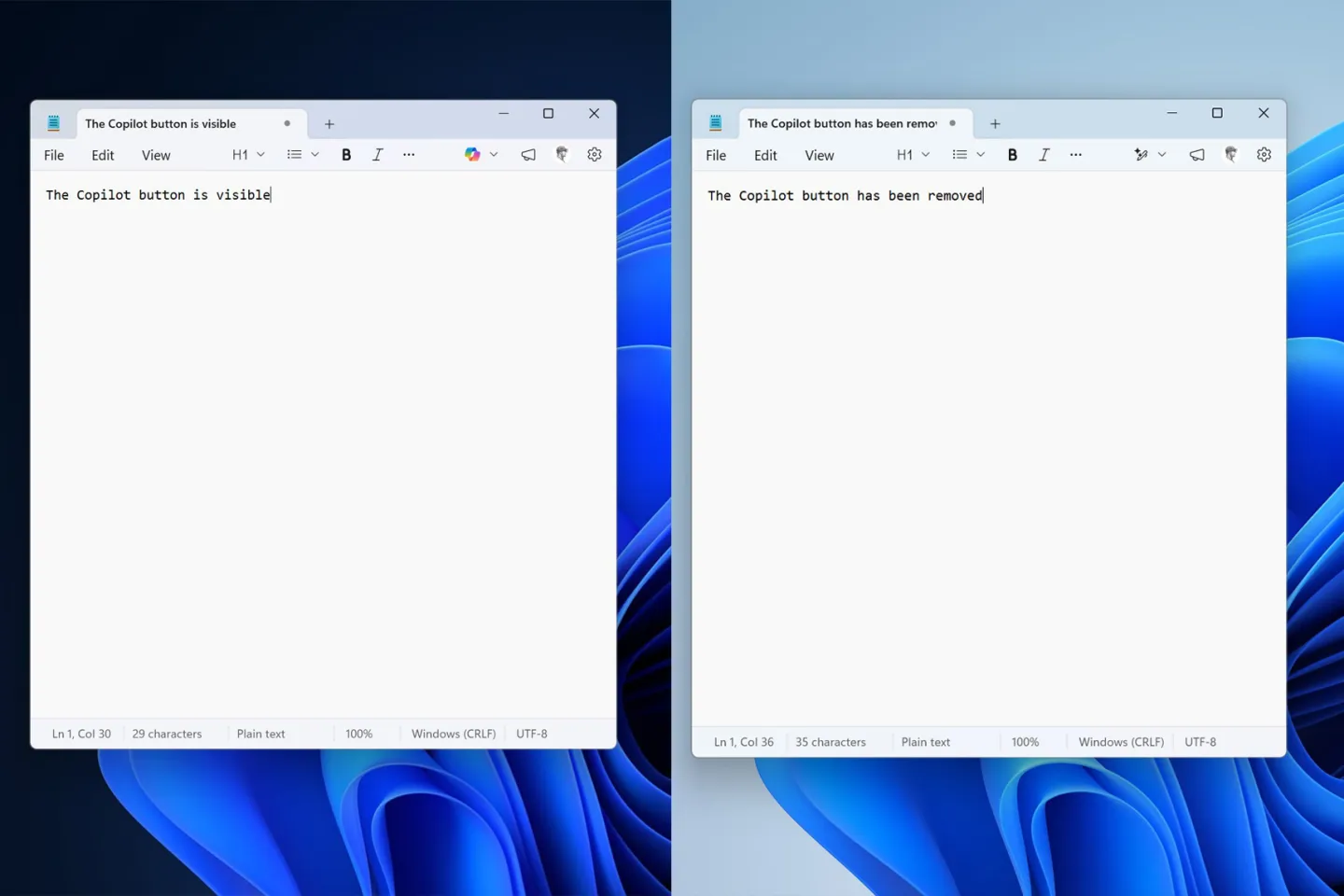

Dilansir dari Digital Trends (10 April 2026), Microsoft akhirnya angkat bicara soal kehebohan ini. Menurut pihak perusahaan, frasa “untuk tujuan hiburan” sebenarnya adalah bahasa lama yang tertinggal dari masa-masa Copilot masih berwujud asisten berbasis Bing — yang dulu dikenal sebagai Bing Chat.

Dalam pernyataan resmi kepada Windows Latest, Microsoft mengakui bahwa kalimat tersebut sudah tidak lagi mencerminkan bagaimana Copilot digunakan sekarang ini. Mereka berjanji akan memperbarui redaksi tersebut di revisi ketentuan layanan berikutnya.

Masuk akal sih. Copilot memang sudah jauh berevolusi sejak era Bing Chat. Dulu mungkin lebih terasa seperti chatbot iseng buat tanya-tanya hal sepele. Tapi sekarang? Microsoft ingin kamu menggunakan Copilot untuk membuat dokumen penting, menyusun presentasi, mengelola alur kerja kantor, bahkan menjalankan berbagai tugas di dalam sistem operasi Windows itu sendiri.

Disclaimer AI: Aneh, Tapi Sebenarnya Sudah Umum

Sebenarnya, kalau kita mau jujur, peringatan seperti “jangan andalkan AI untuk saran penting” itu bukan hal baru di industri kecerdasan buatan. Hampir semua platform AI besar punya klausul serupa. Ini semacam perlindungan hukum standar yang sering kita jumpai di bagian fine print.

Tapi masalahnya, menyandingkan peringatan itu dengan frasa “untuk hiburan saja” pada produk yang dijual sebagai alat produktivitas profesional — nah, itu cerita lain. Beda konteks, beda dampak persepsinya.

Bayangkan kamu beli obat di apotek, tapi di kemasannya tertulis “hanya untuk koleksi.” Pasti aneh, kan? Kurang lebih itulah perasaan pengguna Copilot yang membaca syarat layanan tersebut.

Copilot Sedang Berubah Haluan

Yang menarik dari kisruh ini bukan sekadar soal salah kata di dokumen legal. Ini sebenarnya mencerminkan perubahan besar dalam strategi Microsoft soal Copilot.

Beberapa waktu lalu, Microsoft dikenal dengan pendekatan “AI di mana-mana” — Copilot ada di sini, Copilot ada di sana, semuanya pakai Copilot. Tapi nyatanya, tingkat adopsi pengguna tidak secepat yang diharapkan. Banyak pengguna merasa fitur Copilot terasa dipaksakan dan kurang relevan dengan kebutuhan sehari-hari mereka.

Kini, Microsoft tampak mengambil pendekatan yang lebih terukur dan fokus. Bukan lagi “sebar Copilot ke mana-mana,” melainkan “pastikan Copilot benar-benar berguna di tempat yang tepat.” Dan bagian dari perubahan citra itu adalah memastikan tidak ada lagi frasa “hiburan semata” yang menggerogoti kepercayaan pengguna.

Ironi di Balik Penjualan AI

Tapi ada satu poin menarik yang perlu kita renungkan di sini. Di balik semua kehebohan ini, ada ironi yang cukup dalam: bahkan perusahaan yang paling gencar menjual AI pun masih merasa perlu mengingatkan penggunanya untuk tidak terlalu mempercayai teknologi mereka.

Ini bukan kelemahan Microsoft semata. OpenAI, Google, Anthropic — semua punya disclaimer serupa. Karena kenyataannya, AI memang masih bisa salah. Masih bisa halusinasi. Masih bisa memberikan informasi yang keliru dengan sangat meyakinkan.

Jadi meski Microsoft kini menegaskan Copilot bukan untuk hiburan semata, satu hal yang perlu tetap kamu ingat sebagai pengguna: selalu verifikasi output AI sebelum kamu jadikan dasar keputusan penting. Bukan berarti tidak boleh pakai, tapi pakai dengan bijak.

Apa Artinya Buat Pengguna?

Kalau kamu selama ini pakai Copilot di Microsoft 365 atau Windows, tenang saja — tidak ada yang berubah dari sisi teknis. Copilot tetap bisa membantu kamu menulis email, merangkum dokumen, membuat formula Excel, sampai generate presentasi PowerPoint.

Yang berubah hanyalah bagaimana Microsoft mengkomunikasikan produk ini secara resmi. Mereka sedang berbenah, menyesuaikan narasi legal dengan realitas produk yang sudah jauh lebih maju dari versi awalnya.

Dan ini, sebenarnya, adalah langkah yang tepat. Kepercayaan pengguna adalah aset terbesar dalam ekosistem AI. Kalau dari dokumen resmi saja sudah membingungkan, bagaimana pengguna bisa percaya sepenuhnya?

Kesimpulan

Insiden “Copilot untuk hiburan” ini mungkin terdengar sepele, tapi sebenarnya membuka percakapan yang lebih besar: seberapa siap kita — dan perusahaan teknologi raksasa sekalipun — dalam menyampaikan apa sebenarnya kemampuan dan batasan AI kepada publik?

Microsoft sudah berjanji memperbarui bahasa dalam ketentuan layanannya. Tapi lebih dari sekadar soal kata-kata, ini adalah pengingat bahwa transparansi dalam AI bukan kemewahan — itu adalah keharusan.